Trước đây, nhiều AI Agent thường gặp vấn đề khi tích hợp vào các ứng dụng thực tế do thiếu các giao thức chung. Tuy nhiên, tình hình đang thay đổi nhanh chóng. Trong năm qua, các giao thức như AG-UI (tương tác người dùng), A2A (giao tiếp giữa các agent), và MCP (truy cập công cụ) đã cách mạng hóa hệ sinh thái này.

Bài viết này tổng hợp những kiến thức quan trọng về các giao thức cốt lõi (AG-UI, A2A, MCP, ACP) và giới thiệu bộ sưu tập các kho lưu trữ giáo dục tốt nhất để bạn bắt đầu học và xây dựng AI Agent. Danh sách này sẽ cung cấp cho bạn nền tảng và công cụ cần thiết để tham gia vào thế giới AI Agent đầy hứa hẹn.

Mục lục

1. AG-UI – Giao Thức Tương Tác Giữa Agent và Người Dùng

Mặc dù có nhiều framework agent đa bước mạnh mẽ, nhưng việc tích hợp một agent vào ứng dụng thực tế thường gây ra các vấn đề:

- Truyền phản hồi từng token mà không cần máy chủ WebSocket tùy chỉnh.

- Hiển thị tiến trình công cụ trực tiếp, tạm dừng để lấy phản hồi từ con người mà không làm mất ngữ cảnh.

- Giữ trạng thái chia sẻ lớn (mã, bảng, dữ liệu) đồng bộ mà không cần gửi lại mọi thứ đến UI.

- Cho phép người dùng ngắt, hủy hoặc trả lời agent giữa chừng một tác vụ (mà không làm mất trạng thái).

Nguồn: dailydoseofds.com

Hầu hết các backend agent (như LangGraph, CrewAI) có định dạng luồng, logic trạng thái và API gọi công cụ riêng. Điều này có nghĩa là bạn cần viết lại mọi thứ nếu chuyển đổi stack, điều này không khả thi về mặt mở rộng.

✅ Giải pháp: AG-UI

AG-UI là một giao thức mã nguồn mở của CopilotKit giúp thu hẹp khoảng cách này. Nó giúp các nhà phát triển dễ dàng đưa các Agent tương thích vào các client frontend.

AG-UI sử dụng `Server-Sent Events (SSE)` để truyền các sự kiện JSON có cấu trúc từ backend của agent đến frontend. Nó có 16 loại sự kiện, mỗi loại có một payload được định nghĩa rõ ràng, ví dụ:

TEXT_MESSAGE_CONTENTđể truyền token.TOOL_CALL_STARTđể hiển thị quá trình thực thi công cụ.STATE_DELTAđể cập nhật trạng thái chia sẻ (mã, dữ liệu, v.v.).AGENT_HANDOFFđể chuyển giao quyền kiểm soát giữa các agent một cách mượt mà.

Bạn có thể tạo một ứng dụng AG-UI mới bằng lệnh sau:

npx create-ag-ui-app@latest <my agent framework>Việc áp dụng các framework đang diễn ra nhanh chóng với LangGraph, CrewAI, Mastra, LlamaIndex và Agno đã được hỗ trợ.

🎯 AG-UI phù hợp ở đâu trong bộ giao thức agent?

AG-UI bổ sung cho hai giao thức agent hàng đầu khác:

- MCP kết nối agent với công cụ.

- A2A kết nối các agent với nhau.

- AG-UI kết nối agent với người dùng cuối.

AG-UI hoạt động như lớp `REST` của tương tác giữa người và agent với gần như không có boilerplate và dễ dàng tích hợp vào bất kỳ stack công nghệ nào.

Giao thức này hiện có 5.1k sao trên GitHub. Star AG-UI ⭐️

2. A2A – Giao Thức Tương Tác Giữa Agent và Agent

Các hệ thống agent đang trở nên mạnh mẽ hơn, nhưng chúng thiếu một ngôn ngữ chung. Nếu Agent A muốn yêu cầu Agent B giúp thực hiện một tác vụ, nó sẽ yêu cầu:

- Viết API tùy chỉnh.

- Hardcode các điểm cuối (endpoints).

- Tạo bộ điều hợp cho mỗi cặp agent mới.

Điều này dẫn đến việc các agent được xây dựng trên các framework khác nhau (LangGraph, CrewAI…) bị cô lập, không thể phối hợp với nhau.

A2A (Agent-to-Agent) là một giao thức từ Google giải quyết vấn đề này bằng cách sử dụng tiêu chuẩn `JSON-RPC & SSE`. Với A2A, các agent có thể:

- Khám phá khả năng của nhau.

- Quyết định cách giao tiếp (văn bản, biểu mẫu, phương tiện).

- Hợp tác an toàn trong các tác vụ dài hạn.

- Hoạt động mà không làm lộ trạng thái nội bộ, bộ nhớ hoặc công cụ của chúng.

Để bắt đầu, bạn có thể sử dụng Python SDK hoặc JS SDK:

pip install a2a-sdkhoặc

npm install @a2a-js/sdk🧠 Cách A2A hoạt động (Luồng)

- Các agent xuất bản một `JSON Agent Card` (khả năng, điểm cuối, xác thực). Các agent khác sẽ truy xuất nó để biết “ai để gọi và gọi như thế nào”.

- Ủy quyền tác vụ qua JSON-RPC:

- Agent client sử dụng

tasks/sendhoặcsendSubscribeđể khởi tạo một tác vụ. - Các cuộc gọi được thực hiện qua HTTP với các đầu vào có cấu trúc.

- Các agent từ xa phản hồi bằng ID tác vụ và bắt đầu thực thi.

- Agent client sử dụng

- Tiến trình và các tạo phẩm trung gian được truyền qua SSE (

TaskStatusUpdate,TaskArtifactUpdate). - Đầu vào tương tác giữa tác vụ:

- Các agent từ xa có thể tạm dừng và phát ra `input-required`.

- Agent gọi phản hồi bằng đầu vào bổ sung thông qua cùng ID tác vụ.

- Các agent trao đổi văn bản, dữ liệu, tệp (như âm thanh/video) thông qua các “Phần” và “Tạo phẩm” có cấu trúc.

✅ Ví dụ: Hợp tác Agent từ đầu đến cuối

Đây là một ví dụ rất đơn giản:

- Người dùng giao Agent A một tác vụ phức tạp.

- Agent A chia nó thành các tác vụ con.

- Nó tìm thấy Agent B, C, D bằng cách sử dụng Agent Card của chúng.

- Nó ủy quyền công việc bằng các cuộc gọi A2A.

- Các agent đó chạy song song, truyền cập nhật và yêu cầu đầu vào bổ sung.

- Agent A tập hợp và hợp nhất các kết quả.

Đó là cách các agent giao tiếp với nhau. Mặc dù vẫn còn mới, việc chuẩn hóa sự hợp tác giữa các Agent là rất tốt, tương tự như cách MCP làm cho tương tác giữa Agent và công cụ. MCP mở rộng khả năng của một agent duy nhất. A2A mở rộng cách các agent có thể hợp tác, không phụ thuộc vào backend/framework.

Nguồn: dailydoseofds.com

Nếu bạn quan tâm, hãy đọc thêm bài viết MCP vs A2A của Auth0.

Giao thức này có hơn 18k sao trên GitHub. Star A2A ⭐️

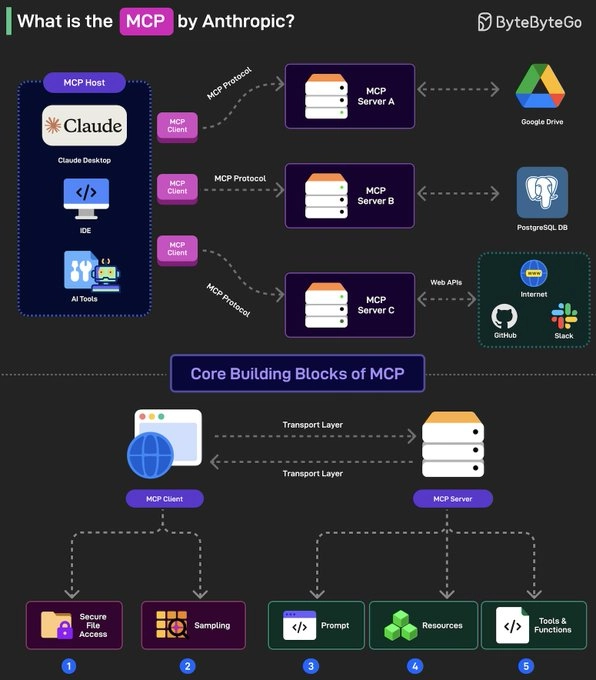

3. MCP – Giao Thức Ngữ Cảnh Mô Hình

MCP (Model Context Protocol) là nỗ lực của Anthropic nhằm chuẩn hóa cách các ứng dụng cung cấp ngữ cảnh và công cụ cho LLM. Giống như USB-C cho phần cứng, MCP là một giao diện phổ quát để các mô hình AI “kết nối” với các nguồn dữ liệu và công cụ.

Thay vì viết các wrapper tùy chỉnh cho mỗi dịch vụ (GitHub, Slack, tệp, DBs), bạn có thể expose các công cụ bằng MCP để nó có thể:

- Liệt kê các công cụ có sẵn (

tools/list). - Gọi một công cụ (

tools/call). - Nhận lại kết quả có cấu trúc, có kiểu.

Điều này mô phỏng các API gọi hàm nhưng hoạt động trên nhiều nền tảng và dịch vụ.

Thông số kỹ thuật trước đây khá tối giản (sử dụng JSON-RPC qua stdio hoặc HTTP). Xác thực không được định nghĩa rõ ràng, đó là lý do tại sao nhiều triển khai đã bỏ qua nó hoàn toàn.

Hiện nay, khi MCP được áp dụng ngày càng nhiều, Anthropic đã thực hiện những cải tiến lớn (đặc biệt là về bảo mật) với các bản cập nhật Spec mới của họ (MCP v2025-06-18).

Nguồn: dailydoseofds.com

Về cơ bản, MCP tuân theo kiến trúc client-server, nơi một ứng dụng host có thể kết nối với nhiều server. Dưới đây là cách các thành phần phù hợp với nhau:

- `MCP hosts` – các ứng dụng như Claude Desktop, Cursor, Windsurf hoặc các công cụ AI muốn truy cập dữ liệu qua MCP.

- `MCP Clients` – các client giao thức duy trì kết nối 1:1 với các MCP server, đóng vai trò cầu nối giao tiếp.

- `MCP Servers` – các chương trình nhẹ, mỗi chương trình expose các khả năng cụ thể (như đọc tệp, truy vấn cơ sở dữ liệu…) thông qua Giao thức Ngữ cảnh Mô hình được chuẩn hóa.

- `Local Data Sources` – các tệp, cơ sở dữ liệu và dịch vụ trên máy tính của bạn mà các MCP server có thể truy cập an toàn. Ví dụ, một MCP server tự động hóa trình duyệt cần quyền truy cập vào trình duyệt của bạn để hoạt động.

- `Remote Services` – các API bên ngoài và hệ thống dựa trên đám mây mà các MCP server có thể kết nối.

Nguồn: ByteByteGo3

Nếu bạn quan tâm đến việc đọc thêm, dưới đây là một vài tài liệu hay:

- The guide to MCP I never had trên Medium.

- What is the Model Context Protocol (MCP)? của nhóm Builder.io.

4. ACP – Giao Thức Giao Tiếp Agent Dựa Trên REST/Stream

ACP (Agent Communication Protocol) được xây dựng dựa trên nhiều ý tưởng của A2A nhưng tiến xa hơn một bước. Đây là một giao thức mở để giao tiếp giữa các AI agent, ứng dụng và con người. Nó hoạt động qua API RESTful được chuẩn hóa và hỗ trợ:

- Tương tác đa phương thức.

- Truyền phản hồi.

- Các mẫu có trạng thái hoặc không trạng thái.

- Khám phá agent trực tuyến và ngoại tuyến.

- Thiết kế ưu tiên bất đồng bộ cho các tác vụ dài hạn (nhưng cũng hoạt động với các cuộc gọi đồng bộ).

Có hai thành phần chính:

- `ACP client`: được sử dụng bởi các agent, ứng dụng hoặc dịch vụ để thực hiện các yêu cầu thông qua giao thức ACP.

- `ACP server`: host một hoặc nhiều agent, nhận các yêu cầu và trả về kết quả bằng ACP. Đây là cách các agent được expose qua REST.

Luồng kiến trúc điều phối đa agent nâng cao

Giao thức này đủ đơn giản để sử dụng với các công cụ HTTP tiêu chuẩn như curl, Postman hoặc các yêu cầu trình duyệt. Nhưng trong trường hợp bạn muốn tích hợp ACP theo chương trình, một Python SDK chính thức và Typescript SDK đã có sẵn.

Bạn có thể sử dụng lệnh này để thêm ACP SDK:

uv add acp-sdk🎯 ACP khác A2A như thế nào?

Trong khi cả hai đều hỗ trợ ủy quyền tác vụ, streaming, nội dung đa phương thức và khám phá agent:

- A2A tập trung vào sự hợp tác giữa các agent.

- ACP mở rộng điều đó để bao gồm tương tác giữa người và ứng dụng.

- ACP sử dụng REST + OpenAPI + các định dạng multipart.

- A2A sử dụng JSON-RPC + SSE.

Việc khám phá được thực hiện thông qua một `Agent Manifest`, tương tự như `Agent Card` của A2A.

ACP được phát triển như một tiêu chuẩn của Linux Foundation, với Nền tảng BeeAI làm triển khai tham chiếu.

Giao thức vẫn độc lập với các triển khai nội bộ và đảm bảo nó phục vụ hệ sinh thái rộng lớn hơn thay vì bất kỳ nhà cung cấp nào.

Nếu bạn mới bắt đầu, hãy xem khóa học ngắn của DeepLearning.AI và hướng dẫn bắt đầu nhanh.

Ngoài ra, hãy xem các ví dụ về agent cho thấy cách sử dụng ACP trên các framework AI phổ biến.

5. MCP for Beginners – Khái Niệm và Nền Tảng Với Ví Dụ Thực Tế Của Microsoft

Tài liệu học tập mã nguồn mở này của Microsoft cung cấp một lộ trình học tập có cấu trúc với các trường hợp sử dụng trong thế giới thực. Nó bao gồm các ví dụ mã hóa thực tế trên các ngôn ngữ phổ biến như C#, Java, JavaScript, TypeScript và Python.

Bằng cách làm theo tài liệu này, bạn có thể dễ dàng nắm bắt hệ sinh thái MCP và hiểu cách xây dựng hoặc mở rộng các hệ thống tuân thủ MCP từ đầu.

Mặc dù có một số blog tuyệt vời, nhưng chúng không thể bao gồm tất cả các chi tiết. Dưới đây là danh sách đầy đủ các chủ đề được đề cập trong tài liệu:

| Module | Topic | What You will learn |

| :---: | :--- | :--- |

| 00 | MCP Introduction | Why MCP matters, real-world use cases |

| 01 | Core Concepts | Client-server architecture, messaging patterns |

| 02 | Security | Threats, best practices, OAuth2 examples |

| 03 | Getting Started | Env setup, first server & client in multiple languages |

| 3.1–3.3 | Hands-on | Build server, build client, integrate LLM client |

| 3.4–3.6 | Dev Tools | Hook into VS Code, use SSE, and HTTP streaming |

| 3.7–3.9 | Tooling & Deployment | Use AI Toolkit, test, and deploy MCP servers |

| 04 | Practical Implementation | Real multilingual SDK examples & debugging |

| 05 | Advanced Topics | Multimodal workflows, scaling, routing, security, web search, OAuth2, root-contexts |

| 5.x | Deep Dives | Azure integration, multimodal, OAuth2 demo, sampling, routing & scaling strategies |

| 06 | Community Contribution | How to report issues, contribute code/docs |

| 07 | Lessons from Early Adopters | Real-world case studies and deployment insights |

| 08 | Best Practices | Resilience, performance, test & fault tolerance |

| 09 | Case Studies | In-depth architecture breakdowns and examples |

| 10 | Hands-On Lab | End-to-end MCP server with AI Toolkit in VS Code |Nó có 5.1k sao trên GitHub. Star MCP for Beginners ⭐️

6. 12-Factor Agents – Các Nguyên Tắc Xây Dựng Ứng Dụng LLM Đáng Tin Cậy

Ngay cả khi LLM trở nên mạnh mẽ hơn, việc xây dựng phần mềm AI đáng tin cậy vẫn phụ thuộc vào cách bạn thiết kế xung quanh chúng. Kho lưu trữ này của Dex Horthy đúc kết các bài học từ việc xây dựng các agent cấp sản xuất thành 12 nguyên tắc cốt lõi.

Trọng tâm của mỗi LLM agent là một vòng lặp:

- LLM quyết định bước tiếp theo bằng cách sử dụng các lệnh gọi công cụ có cấu trúc.

- Mã thực thi lệnh gọi công cụ.

- Kết quả được thêm vào cửa sổ ngữ cảnh.

- Lặp lại cho đến khi bước tiếp theo được xác định là “hoàn thành”.

Nhưng cuối cùng, cách tiếp cận này không hoạt động hiệu quả như chúng ta mong muốn.

Mỗi yếu tố đi kèm với các ví dụ trực quan, giải thích chi tiết và đoạn mã. Dưới đây là tổng quan nhanh về tất cả 12 yếu tố (kèm liên kết để tìm hiểu thêm):

- Ngôn ngữ tự nhiên thành lệnh gọi công cụ: chuyển đổi đầu vào của người dùng thành các hành động có cấu trúc (JSON hoặc lệnh gọi hàm) để mã xác định xử lý thực thi một cách đáng tin cậy.

- Tự chủ prompt: đừng giao phó kỹ thuật prompt của bạn cho một framework. Xử lý prompt như mã (được kiểm soát phiên bản, được kiểm tra, dễ cập nhật).

- Tự chủ cửa sổ ngữ cảnh: chỉ gửi những nội dung quan trọng đến mô hình. Cắt bỏ bất cứ thứ gì không cần thiết để duy trì tốc độ và tránh chạm giới hạn.

- Công cụ chỉ là đầu ra có cấu trúc: khi agent của bạn sử dụng một công cụ, hãy để nó phản hồi bằng JSON sạch, dễ đọc mà mã của bạn có thể hiểu được.

- Thống nhất trạng thái thực thi và trạng thái nghiệp vụ: giữ việc theo dõi bước của agent (những gì nó đang làm) và dữ liệu nghiệp vụ (những gì nó đang xử lý) cùng nhau ở một nơi. Chế độ xem thống nhất này cho phép bạn phát lại, gỡ lỗi và giám sát hành vi của agent một cách dễ dàng.

- Khởi chạy/Tạm dừng/Tiếp tục với API đơn giản: các agent nên được kiểm soát bằng các API đơn giản để bắt đầu, tạm dừng và tiếp tục quy trình làm việc.

- Liên hệ con người bằng lệnh gọi công cụ: bất cứ khi nào một agent cần trợ giúp hoặc đầu vào, hãy để nó giao tiếp với con người bằng cách sử dụng cùng các công cụ (như thông báo, yêu cầu phê duyệt) như các tác vụ tự động.

- Tự chủ luồng kiểm soát của bạn: đừng để một công cụ che giấu những gì agent đang làm. Giữ các bước rõ ràng để bạn có thể kiểm tra hoặc thay đổi chúng.

- Nén lỗi vào cửa sổ ngữ cảnh: tóm tắt lỗi và đưa chúng vào cửa sổ ngữ cảnh của agent để mô hình có thể học và phục hồi từ lỗi. Đừng gửi nhật ký đầy đủ, chỉ những gì giúp nó khắc phục sự cố.

- Các agent nhỏ, tập trung: thiết kế các agent để làm tốt một việc, tuân theo nguyên tắc khả năng ghép nối. Các agent nhỏ, tập trung dễ xây dựng và kiểm tra hơn.

- Kích hoạt từ bất kỳ đâu, đáp ứng người dùng ở mọi nơi: cho phép các agent được kích hoạt bởi các sự kiện từ bất kỳ nguồn nào (API, cron job, hành động của người dùng) để chúng phù hợp với các quy trình làm việc khác nhau.

- Biến agent của bạn thành một bộ giảm trạng thái (stateless reducer): thiết kế các agent để xử lý đầu vào và trả về đầu ra mà không giữ trạng thái nội bộ giữa các lần chạy. Các agent không trạng thái dễ mở rộng, kiểm tra và phục hồi từ lỗi hơn.

Đây là một trong những kho lưu trữ giá trị nhất hiện có. Nó bao gồm lịch sử hành trình của agent (điều gì đã đưa chúng ta đến đây), điều gì xảy ra khi LLM trở nên thông minh hơn và nhiều hơn thế nữa với các ví dụ trực quan.

Nó có 8.9k sao trên GitHub. Star 12-Factor Agents ⭐️

7. Agents Towards Production – Hướng Dẫn Thực Tế Bằng Code Để Xây Dựng AI Agent GenAI Trong Thế Giới Thực

Nếu bạn tò mò về cách đưa ý tưởng GenAI agent của mình từ khái niệm đến sản xuất, kho lưu trữ này là hướng dẫn từng bước của bạn. Nó chứa đầy đủ các hướng dẫn thực tế, định hướng theo code được thiết kế để giúp bạn xây dựng các agent cấp sản xuất.

Mỗi hướng dẫn được gói gọn trong thư mục riêng, hoàn chỉnh với các notebook và mẫu code có thể chạy được, giúp bạn chuyển từ khái niệm sang agent hoạt động chỉ trong vài phút. Bạn sẽ tìm thấy nội dung bao quát toàn bộ vòng đời của GenAI agent, từ tạo mẫu đến triển khai với các mẫu có thể tái sử dụng và các bản thiết kế trong thế giới thực.

Một số điểm nổi bật của hướng dẫn:

- Triển khai GPU: Triển khai agent ở quy mô lớn bằng cách sử dụng Runpod để suy luận hiệu suất cao.

- Khả năng quan sát: Thêm dấu vết, nhật ký và gỡ lỗi với LangSmith và Qualifire, để bạn có thể giám sát agent theo thời gian thực.

- Phối hợp đa agent: quy trình làm việc của agent và trao đổi tin nhắn bằng giao thức A2A.

- Bảo mật & Hàng rào bảo vệ: Học cách ngăn chặn prompt injection và đầu ra độc hại bằng Qualifire, LlamaFirewall và các ví dụ tấn công với Apex.

- Hệ thống bộ nhớ: Sử dụng Redis để thiết lập bộ nhớ ngắn hạn và dài hạn lai được hỗ trợ bởi tìm kiếm ngữ nghĩa.

- Tích hợp tìm kiếm web: Xây dựng agent thu thập và xử lý dữ liệu web trực tiếp bằng API Tavily.

Ngoài ra còn có các hướng dẫn về fine-tuning, frontends, đóng gói và nhiều hơn nữa, tất cả đều sử dụng các framework phổ biến với các thực hành tốt nhất.

Nó có 8.5k sao trên GitHub. Star Agents Towards Production ⭐️

8. GenAI Agents – Triển Khai AI Agent GenAI, Từ Đơn Giản Đến Nâng Cao

Kho lưu trữ này đóng vai trò là một tài nguyên tuyệt vời để học, xây dựng và chia sẻ các GenAI agent (cộng đồng), từ các bot trò chuyện đơn giản đến các hệ thống đa agent phức tạp.

Mọi khái niệm đều được dạy thông qua các notebook có thể chạy được, với khoảng `40+ dự án được thêm vào thông qua các cuộc thi hackathon`. Nó rất thực tế và cực kỳ hữu ích.

Bạn sẽ tìm thấy các ví dụ sử dụng LangGraph, CrewAI, OpenAI Swarm, LangChain, PydanticAI và nhiều hơn nữa.

Thể loại hướng dẫn

Danh sách các thể loại và những gì được đề cập:

- Dành cho người mới bắt đầu

- Simple Conversational Agent (ngữ cảnh/lịch sử)

- QA Agent (hỏi/trả lời với LLM)

- Data Analysis Agent (NLP + truy vấn tập dữ liệu)

- Hướng dẫn Framework

- Quy trình làm việc của LangGraph

- Model Context Protocol (kết nối với công cụ/dữ liệu bên ngoài)

- Giáo dục & Nghiên cứu

- ATLAS (công cụ lập kế hoạch học thuật đa agent)

- Scientific Paper Agent

- Chiron (gia sư kiểu Feynman)

- Kinh doanh/Chuyên nghiệp

- Customer Support & Sentiment Agent

- Bộ công cụ phân tích hợp đồng

- End-to-end Test Automation Agent

- Sáng tạo & Tiện ích

- Công cụ tạo thơ với TTS

- Agent soạn nhạc

- Engine trò chơi trinh thám

Bạn có thể kiểm tra danh sách đầy đủ các triển khai trong readme. Nó có 14.5k sao trên GitHub. Star GenAI Agents ⭐️

9. Awesome LLM Apps – Bộ Sưu Tập Các Ứng Dụng LLM Tuyệt Vời Với AI Agent và RAG

Kho lưu trữ này có một bộ sưu tập tuyệt vời các ứng dụng LLM được xây dựng với RAG, AI Agent, các nhóm đa agent, MCP, các agent chơi game tự động, Voice Agent và nhiều hơn nữa. Sử dụng các mô hình từ OpenAI, Anthropic, Google và các mô hình mã nguồn mở như DeepSeek, Qwen hoặc Llama mà bạn có thể chạy cục bộ trên máy tính của mình.

Một số dự án nổi bật:

- AI Meme Generator Agent (Trình duyệt)

- AI System Architect Agent

- AI Social Media News and Podcast Agent

- AI Competitor Intelligence Agent Team

- Voice RAG Agent (OpenAI SDK)

- AI Blog Search (RAG)

- Local ChatGPT Clone với Bộ nhớ

- Trò chuyện với Video YouTube

- Trò chuyện với Gmail

- AI Travel Planner MCP Agent

Nếu bạn đang xây dựng với LLM, kho lưu trữ này giống như một kho ý tưởng. Nó có hơn 50k sao trên GitHub. Star Awesome LLM Apps ⭐️

10. OpenAgents – Nền Tảng Mở Cho Các Agent Ngôn Ngữ Trong Thế Giới Thực

OpenAgents (của xlang-ai) là một nền tảng mã nguồn mở giúp người dùng và nhà phát triển dễ dàng tương tác và xây dựng các AI agent trong thế giới thực thông qua một giao diện web đơn giản.

Dưới đây là cái nhìn nhanh về cách nó được thiết kế:

Nó hiện có ba agent mạnh mẽ:

- `Data Agent`: cho phép bạn chạy các truy vấn Python hoặc SQL, làm sạch dữ liệu và tạo trực quan hóa trực tiếp qua chat.

- `Plugins Agent`: kết nối với hơn 200 plugin hàng ngày (như thời tiết, mua sắm hoặc Wolfram Alpha), và có thể thông minh chọn đúng plugin cho tác vụ.

- `Web Agent`: sử dụng tiện ích mở rộng Chrome để duyệt các trang web thay mặt bạn (như điền biểu mẫu, đăng lên Twitter, lấy chỉ đường).

Bạn có thể xem tài liệu chính thức để xem video demo và hướng dẫn đầy đủ.

Tóm lại, OpenAgents giống như ChatGPT Plus nhưng mã nguồn mở và có thể tùy chỉnh một chút, khiến nó có khả năng phân tích dữ liệu, sử dụng công cụ và duyệt tự động, tất cả được xây dựng để dễ dàng mở rộng hoặc tự host.

Nó có 4.4k sao trên GitHub. Star OpenAgents ⭐️

11. System Prompts – Bộ Sưu Tập Khổng Lồ Các Prompt Hệ Thống Thực Tế, Công Cụ & Cấu Hình AI

Kho lưu trữ này là một thư viện khổng lồ các prompt hệ thống và tệp cấu hình từ hơn 15 sản phẩm AI thực tế như v0, Cursor, Manus, Same.dev, Lovable, Devin, Replit Agent, Windsurf Agent, VSCode Agent, Dia Browser, Trae AI, Cluely, Xcode & Spawn, và thậm chí cả các agent mã nguồn mở như Codex CLI, Bolt, RooCode.

Với hơn 7.500 dòng nội dung, đây là một trong những tài liệu tham khảo lớn nhất và thực tế nhất cho bất kỳ ai quan tâm đến cách các hệ thống AI hiện đại được “hướng dẫn” để hoạt động, suy luận và tương tác.

Điều này cực kỳ hữu ích nếu bạn:

- Đang xây dựng LLM agent hoặc copilot.

- Đang tạo các prompt hệ thống/hướng dẫn tốt hơn.

- Đang đảo ngược kỹ thuật logic đằng sau hành vi của agent.

Ngoài ra còn có một bộ sưu tập vững chắc khác (~3k⭐️) mà bạn có thể thấy hữu ích.

Kho lưu trữ System Prompts có hơn 67k sao trên GitHub. Star System Prompts ⭐️

12. 500 AI Agents Projects – Bộ Sưu Tập Các Trường Hợp Sử Dụng AI Agent Trên Các Ngành Công Nghiệp

Nếu bạn tò mò về các ứng dụng AI agent trong thế giới thực, kho lưu trữ này nêu bật hơn 500 trường hợp sử dụng trên các ngành như y tế, tài chính, giáo dục, bán lẻ, logistics, trò chơi và nhiều hơn nữa.

Mỗi trường hợp sử dụng liên kết đến một dự án mã nguồn mở, biến nó thành một hướng dẫn thực hành thay vì chỉ là một danh sách ý tưởng. Nhiều ví dụ được xây dựng bằng các framework như CrewAI, AutoGen, LangGraph và Agno. Ví dụ, các luồng CrewAI bao gồm:

- Email Auto Responder.

- Meeting Assistant.

- Write a Book hoặc Screenplay Writer.

- Marketing Strategy Generator.

- Landing Page Generator.

Bạn cũng sẽ tìm thấy các kiến trúc agent độc đáo như các agent LangGraph tích hợp NVIDIA.

Đây là một kho lưu trữ tuyệt vời để duyệt và lấy cảm hứng. Nó có 1.8k sao trên GitHub. Star 500 AI Agents Projects ⭐️

Các giao thức có thể nghe có vẻ nhàm chán, nhưng chúng là lý do các agent sẽ thực sự hoạt động trong thế giới thực. Các framework sẽ thay đổi, nhưng các giao thức thì không. Vì vậy, bạn nên dành thời gian để tìm hiểu những kiến thức cơ bản này.

Nếu bạn có bất kỳ câu hỏi, phản hồi nào hoặc cuối cùng xây dựng được điều gì đó thú vị, vui lòng chia sẻ trong phần bình luận. Chúc bạn một ngày tuyệt vời! Hẹn gặp lại lần sau 🙂

Bạn có thể xem các công việc của tôi tại anmolbaranwal.com. Cảm ơn bạn đã đọc! 🥰

Theo dõi CopilotKit & AG-UI trên Twitter và chào hỏi!

Nếu bạn muốn xây dựng điều gì đó tuyệt vời, hãy tham gia Discord của AG-UI.